Ein CMS auf Serverless-Infrastruktur: Scale to Zero ohne klassisches Hosting

Eine serverlose CMS-Architektur ändert die Ökonomie von Leerlaufkapazität, Burst-Traffic und Plattform-Betrieb – anders als klassische Hosting-Modelle das selten sauber abbilden.

Klassisches CMS-Hosting setzt voraus, dass immer jemand fürs Warten zahlt.

Auch bei ruhigem Traffic bleibt Infrastruktur bereitgestellt. Auch wenn die Performance meist passt, denken Teams noch über Instanzgrößen, Cache-Schichten, Failover und Traffic-Spikes nach.

Diese operative Form passte zur früheren Web-Welt – schwächer zur modernen Publishing-Infrastruktur.

Was „scale to zero“ ändert

Der Begriff klingt nach Kostenoptimierung – der Nutzen ist aber breiter.

Eine Scale-to-Zero-Architektur ändert die Denkweise bei:

- Leerlauf-Umgebungen

- Long-Tail-Sites

- Burst-Traffic

- Plattform-Multi-Tenancy

- Preview- und Experimentier-Oberflächen

Kann ein CMS laufen, ohne dass Sie Leerlaufkapazität warm halten müssen, sehen die Hosting-Ökonomien für viele Sites ganz anders aus.

Warum das für Publishing-Plattformen zählt

CMS-Traffic ist oft ungleichmäßig. Manche Sites sind lange ruhig und spiken dann wegen Launch, Kampagne oder Social-Burst.

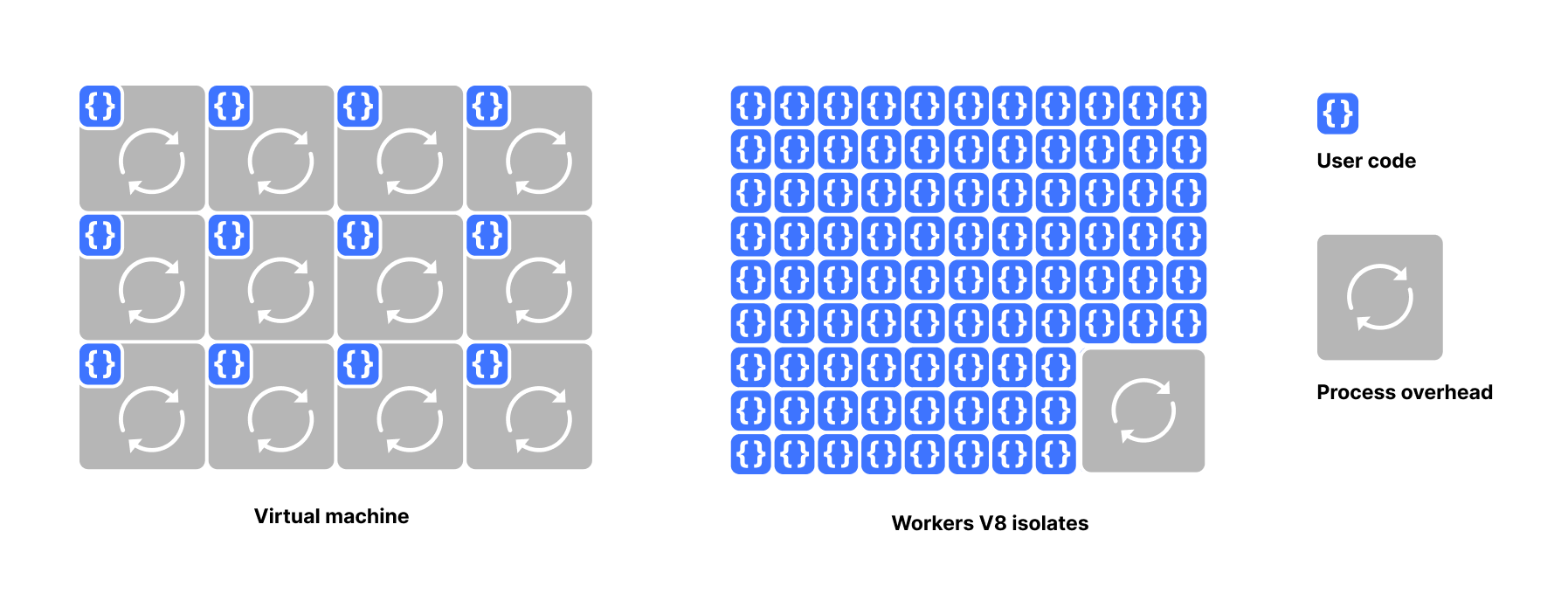

Ein klassischer Stack reagiert mit Überprovisionierung, geteilter Kontention oder komplexem Tuning. Ein serverloses Modell passt besser, wenn das System auf Traffic reagieren soll statt ihn ständig vorwegzunehmen.

Warum das zu EmDash passt

EmDash ist mit einer stärkeren Serverless-Story gebaut als WordPress. Das zählt für:

- Plattform-Betreiber mit vielen Sites

- Teams, die niedrigere Leerlaufkosten wollen

- Projekte mit klarerem Skalierungsverhalten

- Organisationen, die verwaltete Infrastruktur-Primitive Server-Babysitting vorziehen

Nicht jede Site muss gleich deployt werden – die Architektur ist aber an moderne Deployment-Erwartungen ausgerichtet statt dagegenzuarbeiten.

Was Teams trotzdem planen sollten

Serverless ersetzt operatives Denken nicht. Sie kümmern sich weiter um:

- Cache-Strategie

- Asset-Auslieferung

- Hintergrund-Workflows

- Datenlokalität

- Observability

Das sind aber bessere Probleme als Energie darauf zu verwenden, unterausgelastete Compute-Ressourcen nur für den Fall am Leben zu halten.

Praktisches Argument

Der beste Grund, ein CMS auf Serverless zu betreiben, ist kein Hype. Publishing-Systeme profitieren meist deutlich mehr von flexiblem Compute als von dauerhaft reserviertem Compute.

Das ist der Kernvorteil: Sie achten mehr auf die Arbeit des Systems und weniger auf die darauf wartende Maschinerie.